Los economistas tienen mejores herramientas que nunca; la pregunta es si están respondiendo las preguntas correctas

Francisco A. Ramírez

Nuestras ideas y conceptos pueden ser comparados con lentes a través de los cuales vemos el mundo.

– Simon Blackburn, Think: a compelling introduction to philosophy

Los economistas miran la realidad a través de datos. Pero, como sugiere Simon Blackburn, lo que vemos depende tanto de los datos como de los lentes conceptuales que usamos para interpretarlos. ¿Qué podemos aprender, entonces, sobre cómo funciona la economía a partir de información necesariamente incompleta? La pregunta suena técnica, pero no lo es. En el fondo, es una cuestión sobre qué significa conocer algo en economía: qué cuenta como evidencia, cuándo una relación puede llamarse causal y en qué condiciones esas afirmaciones son creíbles.

En las últimas dos décadas, la inferencia causal ha transformado el lenguaje de la investigación empírica. Experimentos naturales, variables instrumentales y diseños de regresión discontinua han pasado de ser herramientas especializadas a convertirse en el estándar de oro en muchos campos. Para algunos, esto constituye una revolución metodológica. Para otros, no es más que econometría tradicional con mejor marketing. La realidad, como suele ocurrir, es más interesante.

La econometría nació de una incomodidad fundamental: los datos no son la economía. Son realizaciones imperfectas de un proceso subyacente, ruidoso, incompleto y moldeado por decisiones humanas e instituciones. Durante décadas, la respuesta dominante fue construir modelos que capturaran ese proceso. El economista especificaba una estructura teórica, estimaba sus parámetros y extraía conclusiones. Este enfoque ha producido herramientas extraordinariamente útiles, desde los modelos VAR utilizados en bancos centrales hasta los modelos de equilibrio general que guían la política económica, pero siempre ha convivido con una pregunta incómoda: ¿cuándo una relación estimada es realmente causal y cuándo es simplemente una correlación bien ajustada?

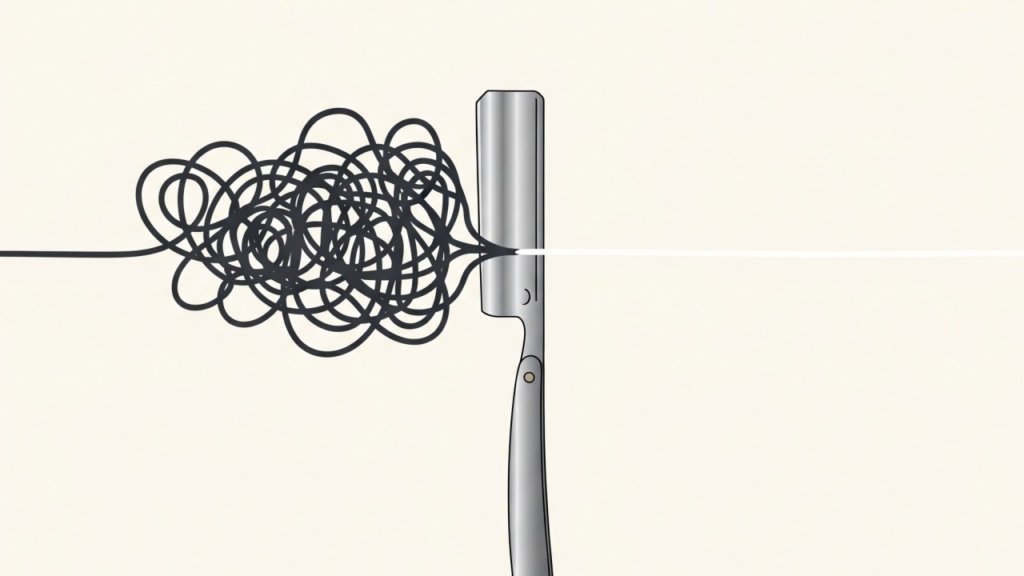

La inferencia causal moderna cambia el punto de partida. En lugar de comenzar con un modelo, comienza con una pregunta aparentemente sencilla, por ejemplo, ¿cómo saber si una política, una institución o una decisión económica produjo realmente el resultado que observamos, y no simplemente coincidió con él? Pero esa simplicidad es engañosa. La pregunta obliga a enfrentar el problema del contrafactual ¿Qué habría ocurrido con el resultado si la política hubiera sido distinta? Ese mundo alternativo nunca se observa. Toda respuesta, por tanto, depende de supuestos. La contribución más importante de esta tradición no ha sido eliminarlos, sino obligar a hacerlos explícitos, defendibles y, cuando es posible, verificables.

Esta diferencia de enfoque se vuelve especialmente clara cuando se distingue entre evaluar lo que ya ocurrió y anticipar lo que podría ocurrir. Los métodos de inferencia causal han demostrado una gran fortaleza en el análisis ex post. Permiten estimar con credibilidad el impacto de políticas ya implementadas, aprovechando variaciones cuasiexperimentales. No es casual que el trabajo de Guido Imbens y Joshua Angrist haya sido tan influyente en este ámbito. Pero diseñar políticas es otra cosa. Implica responder preguntas sobre escenarios no observados, donde entran en juego interacciones complejas y efectos de equilibrio general. Ahí, los modelos estructurales siguen siendo indispensables, como ha insistido durante años James Heckman.

Un ejemplo ilustra bien la diferencia. Supongamos que un gobierno introduce un subsidio a la educación superior. Con un diseño de regresión discontinua, es posible estimar con bastante precisión el efecto del programa sobre los ingresos de quienes lo reciben. Pero diseñar una expansión del programa exige responder preguntas distintas. ¿Qué ocurrirá con los salarios cuando aumente la oferta de trabajadores calificados?, ¿cómo reaccionarán las empresas?, ¿qué pasará con la desigualdad? Estas son preguntas que ningún experimento natural puede responder por sí solo. Requieren un modelo del sistema.

El problema surge cuando se pretende que una de estas aproximaciones sustituya a la otra. Un economista que trabaja exclusivamente con modelos puede producir una representación elegante y coherente de la economía que descansa, sin embargo, en supuestos de identificación nunca examinados. Un economista que se limita a diseños cuasiexperimentales puede ofrecer respuestas muy precisas a preguntas muy específicas, pero perder de vista las fuerzas que operan a nivel del sistema. En política pública, donde importan tanto los efectos agregados como los locales, ninguna de las dos limitaciones es trivial.

La frontera más prometedora no está en elegir entre ambos enfoques, sino en combinarlos. Un análisis robusto comienza con una pregunta causal bien formulada, explicita el proceso generador de datos, hace transparentes los supuestos bajo los cuales la identificación es posible y ancla sus resultados en una teoría económica coherente. Y, sobre todo, reconoce lo que no sabe. Porque si algo enseña la econometría moderna es que la incertidumbre no desaparece: simplemente se vuelve más visible.

Este punto es particularmente relevante fuera de la academia. En bancos centrales, ministerios de hacienda y organismos internacionales, las decisiones rara vez descansan en un único coeficiente estimado con precisión quirúrgica. Se construyen a partir de escenarios, modelos y juicios informados que integran evidencia de múltiples fuentes. En ese contexto, la inferencia causal aporta credibilidad a estimaciones específicas; la econometría estructural aporta coherencia al conjunto. Prescindir de una en nombre de la otra no es una opción realista.

El matemático Richard Hamming solía advertir que el problema más común en la investigación no es la falta de herramientas, sino trabajar en las preguntas equivocadas con las herramientas correctas. La econometría contemporánea dispone de herramientas cada vez más sofisticadas. El desafío, como siempre, es usarlas con criterio. Y ese criterio comienza por reconocer que, detrás de cada estimación, hay una pregunta más profunda: no solo qué muestran los datos, sino qué significa realmente entenderlos.